- Tensor

-

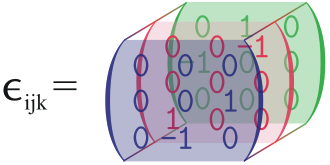

Levi-Civita-Symbol im Dreidimensionalen als Beispiel eines besonders einfachen dreistufigen Tensors

Levi-Civita-Symbol im Dreidimensionalen als Beispiel eines besonders einfachen dreistufigen Tensors

Der Tensor ist ein mathematisches Objekt aus der Algebra und Differentialgeometrie. Der Begriff wurde ursprünglich in der Physik eingeführt und erst später mathematisch präzisiert. Auch heute noch ist die Tensoranalysis ein wichtiges Werkzeug in den physikalischen Disziplinen. Ein Tensor ist eine multilineare Abbildung, also eine Abbildung, welche in jeder Variablen linear ist.

Anschaulich, aber mathematisch unpräzise, kann man sich den Tensor als eine mehrdimensionale Matrix vorstellen:

- Eine Zahl ist ein Tensor 0-ter Stufe.

- Ein (Spalten-) Vektor ist ein Tensor erster Stufe.

- Eine Matrix ist ein Tensor zweiter Stufe.

- Das Levi-Civita-Symbol

im

im  ist ein Beispiel für einen Tensor n-ter Stufe.

ist ein Beispiel für einen Tensor n-ter Stufe.

Beispielsweise ist der mechanische Spannungstensor in der Physik ein Tensor zweiter Stufe - eine Zahl (Stärke der Spannung) oder ein Vektor (eine Hauptspannungsrichtung) reichen nicht immer aus. Eine Matrix M kann als lineare Abbildung aufgefasst werden. So lässt sich der Spannungstensor als Matrix auffassen, die zu einer gegebenen Richtung v die Spannung

in dieser Richtung ausrechnet.

in dieser Richtung ausrechnet.Aber nicht alle Größen mit zwei oder mehr Indizes sind Tensoren (deshalb oben die Bemerkung „... unpräzise“).

Inhaltsverzeichnis

Einleitung

Wort- und Begriffsgeschichte

Das Wort Tensor (lat. tendo „ich spanne“) wurde in den 1840er Jahren von Hamilton in die Mathematik eingeführt; er bezeichnete damit den Absolutbetrag seiner Quaternionen, also noch keinen Tensor im modernen Sinn.

Maxwell scheint den Spannungstensor, den er aus der Elastizitätstheorie in die Elektrodynamik übertrug, selbst noch nicht so genannt zu haben.

In seiner modernen Bedeutung, als Verallgemeinerung von Skalar, Vektor, Matrix, wird das Wort Tensor erstmals von Woldemar Voigt in seinem Buch Die fundamentalen physikalischen Eigenschaften der Krystalle in elementarer Darstellung (Leipzig, 1898) eingeführt.

Unter dem Titel absolute Differentialgeometrie entwickelten Gregorio Ricci-Curbastro und dessen Schüler Tullio Levi-Civita um 1890 die Tensorrechnung auf riemannschen Mannigfaltigkeiten; einem größeren Fachpublikum machten sie ihre Ergebnisse 1900 mit dem Buch Calcolo differenziale assoluto zugänglich, das bald in andere Sprachen übersetzt wurde, und aus dem sich Einstein die mathematischen Grundlagen aneignete, die er zur Formulierung der allgemeinen Relativitätstheorie benötigte. Einstein selbst prägte 1916 den Begriff Tensoranalysis und trug mit seiner Theorie maßgeblich dazu bei, den Tensorkalkül bekannt zu machen; er führte überdies die einsteinsche Summenkonvention ein, nach der über doppelt auftretende Indizes unter Weglassung der Summenzeichen summiert wird.

Unterschiedliche Betrachtungsweisen

Der Begriff des Tensors wird sowohl in der Physik als auch in der Mathematik verwendet. In der Mathematik wird dieses Objekt meistens in der Algebra und der Differentialgeometrie betrachtet. Dabei wird eine koordinatenunabhängige Notation bevorzugt, in den Anwendungen wie in der Physik verwendet man dagegen meist die Indexnotation von Tensoren. Weiterhin werden in der Physik häufig Tensorfelder behandelt, die häufig auch einfach als Tensoren bezeichnet werden. Ein Tensorfeld ist eine Abbildung, die jedem Punkt des Raums einen Tensor zuordnet; viele physikalische Feldtheorien handeln von Tensorfeldern.

Einsteinsche Summenkonvention

Insbesondere in der Tensoranalysis (einem Teilgebiet der Differentialgeometrie) und der Physik ist die einsteinsche Summenkonvention beliebt. Sie verkürzt die Schreibweise von Tensoren. Die Konvention besagt, dass Summenzeichen weggelassen werden können und dabei automatisch über Indizes summiert wird, welche einmal oben und einmal unten stehen. Ein einfaches Beispiel ist die Matrixmultiplikation. Seien A,B zwei Matrizen mit den Komponenten Aik und Bkj. Dann lautet die Komponentendarstellung des Matrixproduktes

Mit der einsteinschen Summenkonvention schreibt man

Ko- und Kontravarianz

Die Begriffe ko- und kontravariant beziehen sich im Zusammenhang mit der Tensorrechnung auf die Koordinatendarstellungen von Vektoren, Linearformen und Tensoren höherer Stufe. Sie beschreiben, wie sich solche Koordinatendarstellungen bezüglich eines Basiswechsels im zugrundeliegenden Vektorraum verhalten.

Legt man in einem n-dimensionalen Vektorraum V eine Basis

fest, so kann jeder Vektor v dieses Raumes durch ein Zahlentupel

fest, so kann jeder Vektor v dieses Raumes durch ein Zahlentupel  , seine Koordinaten, gemessen und dargestellt werden,

, seine Koordinaten, gemessen und dargestellt werden,  . Geht man zu einer anderen Basis von V über, so ändert sich der Vektor selbst nicht, aber die Koordinaten der neuen Basis werden andere sein. Genauer: Ist die neue Basis durch

. Geht man zu einer anderen Basis von V über, so ändert sich der Vektor selbst nicht, aber die Koordinaten der neuen Basis werden andere sein. Genauer: Ist die neue Basis durch  in der alten Basis bestimmt, so ergeben sich die neuen Koordinaten durch Vergleich in

in der alten Basis bestimmt, so ergeben sich die neuen Koordinaten durch Vergleich inalso

oder

oder .

.

Dreht man zum Beispiel eine orthogonale Basis in einem dreidimensionalen euklidischen Raum V um

um die z-Achse, so drehen sich die Koordinatenvektoren im Koordinatenraum

um die z-Achse, so drehen sich die Koordinatenvektoren im Koordinatenraum  ebenfalls um die z-Achse, aber in der entgegengesetzten Richtung um

ebenfalls um die z-Achse, aber in der entgegengesetzten Richtung um  .

.Dieses der Basistransformation entgegengesetzte Transformationsverhalten nennt man kontravariant. Oft werden Vektoren zur Abkürzung der Notation mit ihren Koordinatenvektoren identifiziert, so dass Vektoren allgemein als kontravariant bezeichnet werden.

Eine Linearform oder Kovektor

ist dagegen eine skalarwertige lineare Abbildung

ist dagegen eine skalarwertige lineare Abbildung  auf dem Vektorraum. Man kann ihr als Koordinaten ihre Werte auf den Basisvektoren, αk = α(ek), zuordnen. Die Koordinatenvektoren einer Linearform transformieren sich wie das Basistupel als

auf dem Vektorraum. Man kann ihr als Koordinaten ihre Werte auf den Basisvektoren, αk = α(ek), zuordnen. Die Koordinatenvektoren einer Linearform transformieren sich wie das Basistupel alsweshalb man dieses Transformationsverhalten kovariant nennt. Identifiziert man wieder Linearformen mit ihren Koordinatenvektoren, so bezeichnet man auch allgemein Linearformen als kovariant. Hierbei geht, wie bei Vektoren, die zugrundeliegende Basis aus dem Kontext hervor. Man spricht in diesem Kontext auch von Dualvektoren.

Diese Kurzbezeichnung wird auf Tensorprodukte ausgedehnt (Symbol: Tensormultiplikation

Faktoren, die Vektorräume sind, nennt man kontravariant, Faktoren, die Dualräume sind, nennt man kovariant.

Faktoren, die Vektorräume sind, nennt man kontravariant, Faktoren, die Dualräume sind, nennt man kovariant.Definition

(r,s)-Tensorraum

Im Folgenden sind alle Vektorräume endlichdimensional. Mit L(E;K) bezeichne man die Menge aller Linearformen aus dem K-Vektorraum E in den Körper K. Sind

Vektorräume über K, so werde der Vektorraum der Multilinearformen

Vektorräume über K, so werde der Vektorraum der Multilinearformen  mit

mit  bezeichnet.

bezeichnet.Ist E ein K-Vektorraum, so wird mit E * sein Dualraum bezeichnet. Dann ist

eine Realisierung des Tensorproduktes

eine Realisierung des Tensorproduktes .

.

Setze nun für einen fixierten Vektorraum E mit Dualraum E *

mit r Einträgen von E * und s Einträgen von E. Dieser Vektorraum realisiert das Tensorprodukt

Elemente dieser Menge heißen Tensoren, kontravariant der Stufe r und kovariant der Stufe s. Kurz spricht man von Tensoren vom Typ (r,s). Die Summe r+s heißt Stufe oder Rang des Tensors.

Äußeres Tensorprodukt

Als (äußeres) Tensorprodukt bezeichnet man eine Verknüpfung

zwischen zwei Tensoren. Sei E ein Vektorraum und seien

zwischen zwei Tensoren. Sei E ein Vektorraum und seien  und

und  Tensoren. Das (äußere) Tensorprodukt von t1 und t2 ist der Tensor

Tensoren. Das (äußere) Tensorprodukt von t1 und t2 ist der Tensor  , welcher durch

, welcher durchdefiniert ist. Hierbei sind die

und die

und die  .

.Beispiele

Im Folgenden seien E und F endlichdimensionale Vektorräume.

- Die Menge der (0,0)-Tensoren ist isomorph zum zugrunde liegenden Körper K. Sie ordnen keiner Linearform und keinem Vektor ein Körperelement zu. Deshalb die Bezeichnung als (0,0)-Tensoren.

- (0,1)-Tensoren ordnen keiner Linearform und einem Vektor eine Zahl zu, entsprechen somit den Linearformen L(E,K) = E * auf E.

- (1,0)-Tensoren ordnen einer Linearform und keinem Vektor eine Zahl zu. Sie sind somit Elementen des bidualen Vektorraums E * * . Sie entsprechen bei endlichdimensionalen den Ausgangsvektorräumen E, da hier

gilt (siehe Isomorphismus).

gilt (siehe Isomorphismus).

- Eine lineare Abbildung

zwischen endlichdimensionalen Vektorräumen kann als Element von

zwischen endlichdimensionalen Vektorräumen kann als Element von  aufgefasst werden und sind dann (1,1)-Tensoren.

aufgefasst werden und sind dann (1,1)-Tensoren.

- Eine Bilinearform

lässt sich als ein Element von

lässt sich als ein Element von  auffassen, also als ein (0,2)-Tensor. Insbesondere lassen sich also Skalarprodukte als (0,2)-Tensor auffassen.

auffassen, also als ein (0,2)-Tensor. Insbesondere lassen sich also Skalarprodukte als (0,2)-Tensor auffassen.

- Die Determinante von

-Matrizen, aufgefasst als alternierende Multilinearform der Spalten, ist ein (0,n)-Tensor.

-Matrizen, aufgefasst als alternierende Multilinearform der Spalten, ist ein (0,n)-Tensor.

- Das Kronecker-Delta δ ist wieder ein (0,2)-Tensor. Es ist ein Element von

, und somit also eine multilineare Abbildung

, und somit also eine multilineare Abbildung  . Multilineare Abbildungen sind durch die Wirkung auf die Basisvektoren eindeutig bestimmt. So ist das Kronecker-Delta eindeutig durch

. Multilineare Abbildungen sind durch die Wirkung auf die Basisvektoren eindeutig bestimmt. So ist das Kronecker-Delta eindeutig durch

-

- bestimmt.

- Das Levi-Civita-Symbol oder auch Epsilontensor

, welches zur Berechnung des Kreuzprodukts zwischen Vektoren verwendet werden kann, ist ein Tensor dritter Stufe. Es gilt

, welches zur Berechnung des Kreuzprodukts zwischen Vektoren verwendet werden kann, ist ein Tensor dritter Stufe. Es gilt  . Man schreibt auch ε(ei,ej,ek) = εijk. Da die Räume

. Man schreibt auch ε(ei,ej,ek) = εijk. Da die Räume  und

und  natürlich isomorph sind, lässt man oftmals den Stern weg. Das Levi-Civita-Symbol kann man auch für n Dimensionen definieren. Sowohl das Kronecker-Delta als auch das Levi-Civita-Symbol werden häufig verwendet, um Symmetrieeigenschaften von Tensoren zu untersuchen. Das Kronecker-Delta ist symmetrisch bei Vertauschungen der Indizes, das Levi-Civita-Symbol antisymmetrisch, so dass man mit ihrer Hilfe Tensoren in symmetrische und antisymmetrische Anteile zerlegen kann.

natürlich isomorph sind, lässt man oftmals den Stern weg. Das Levi-Civita-Symbol kann man auch für n Dimensionen definieren. Sowohl das Kronecker-Delta als auch das Levi-Civita-Symbol werden häufig verwendet, um Symmetrieeigenschaften von Tensoren zu untersuchen. Das Kronecker-Delta ist symmetrisch bei Vertauschungen der Indizes, das Levi-Civita-Symbol antisymmetrisch, so dass man mit ihrer Hilfe Tensoren in symmetrische und antisymmetrische Anteile zerlegen kann.

- Ein weiteres Beispiel für einen kovarianten Tensor 2. Stufe ist der Trägheitstensor.

- In der Elastizitätstheorie verallgemeinert man die hookesche Gleichung über den Zusammenhang zwischen Kräften und zugehörigen Dehnungen und Verzerrungen in einem elastischen Medium ebenfalls mit Hilfe der Tensorrechnung durch Einführung des Verzerrungstensors, der Verzerrungen, Deformationen beschreibt, und des Spannungstensors, der die die Deformationen verursachenden Kräfte beschreibt. Siehe dazu auch unter Kontinuumsmechanik nach.

- Sei (V,g) ein metrischer Vektorraum. Die Metrik g ordnet zwei Vektoren v und w des Vektorraums V eine reelle Zahl g(v,w) zu. Ist die Metrik eine lineare Abbildung in beiden Argumenten, so handelt es sich bei der Metrik g um einen Tensor. Genauer gesagt ist die Metrik g ein zweifach kovarianter Tensor. Eine solche Metrik g wird deshalb auch metrischer Tensor genannt. Mit

werden die Koordinaten der Metrik bezüglich einer Basis des Vektorraums V bezeichnet;vi und wj seien die Koordinaten der Vektoren v und w bezüglich derselben Basis. Für die Abbildung zweier Vektoren v und w unter der Metrik g gilt deshalb

werden die Koordinaten der Metrik bezüglich einer Basis des Vektorraums V bezeichnet;vi und wj seien die Koordinaten der Vektoren v und w bezüglich derselben Basis. Für die Abbildung zweier Vektoren v und w unter der Metrik g gilt deshalb

g(v,w) = ∑ gijviwj. i,j - Der Übergang zwischen ko- und kontravarianten Tensoren lässt sich mittels der Metrik durch

xi = ∑ gijxj j - bewerkstelligen.

- Im Fall der allgemeinen Relativitätstheorie ist diese Metrik sogar meist von Punkt zu Punkt verschieden. In diesem Fall hängt diese Funktion noch von einer zusätzlichen Variablen, welche den Ort beschreibt, ab. Ein solches Objekt wird Tensorfeld genannt und weiter unten beschreiben. Dieser metrische Tensor heißt riemannsche Metrik. In der speziellen Relativitätstheorie verwendet man dabei statt der euklidischen Metrik die des Minkowskiraumes. Noch allgemeinere Metriken (allerdings mit derselben Signatur wie die Minkowski-Metrik) werden in der Allgemeinen Relativitätstheorie verwendet. Im Fall der Relativitätstheorie ist dies ein (4,0)-Tensorfeld.

Tensoralgebra

Sei E ein Vektorraum über einem Körper K. Dann ist durch

die sogenannte Tensoralgebra definiert. Mit der Multiplikation, die auf den homogenen Bestandteilen durch das Tensorprodukt gegeben ist, wird T(E) zu einer unitären assoziativen Algebra.

Basis

Basis & Dimension

Sei E wie oben ein Vektorraum. Dann sind die Räume

ebenfalls wieder Vektorräume. Weiterhin sei E nun endlichdimensional mit der Basis

ebenfalls wieder Vektorräume. Weiterhin sei E nun endlichdimensional mit der Basis  . Die duale Basis wird mit

. Die duale Basis wird mit  bezeichnet. Der Raum

bezeichnet. Der Raum  der Tensoren ist dann ebenfalls endlichdimensional und

der Tensoren ist dann ebenfalls endlichdimensional undist eine Basis dieses Raumes. Das heißt, jedes Element

kann durch

kann durchdargestellt werden. Die Dimension dieses Vektorraums ist

. Wie in jedem endlichdimensionalen Vektorraum reicht es auch im Raum der Tensoren zu sagen, wie eine Funktion auf der Basis operiert.

. Wie in jedem endlichdimensionalen Vektorraum reicht es auch im Raum der Tensoren zu sagen, wie eine Funktion auf der Basis operiert.Da die obige Summendarstellung sehr viel Schreibarbeit mit sich bringt, wird oftmals die einsteinsche Summenkonvention verwendet. In diesem Fall schreibt man also

Oftmals identifiziert man die Komponenten des Tensors mit dem Tensor an sich. Siehe dafür unter Tensordarstellungen der Physik nach.

Basiswechsel und Koordinatentransformation

Seien

und

und  jeweils unterschiedliche Basen der Vektorräume

jeweils unterschiedliche Basen der Vektorräume  . Jeder Vektor, also auch jeder Basisvektor

. Jeder Vektor, also auch jeder Basisvektor  kann als Linearkombination der Basisvektoren

kann als Linearkombination der Basisvektoren  dargestellt werden. Der Basisvektor

dargestellt werden. Der Basisvektor  werde dargestellt durch:

werde dargestellt durch:Die Größen

bestimmen also die Basistransformation zwischen den Basen

bestimmen also die Basistransformation zwischen den Basen  und

und  . Das gilt für alle

. Das gilt für alle  . Dieses Verfahren wird Basiswechsel genannt.

. Dieses Verfahren wird Basiswechsel genannt.Ferner seien

die Koordinaten des Tensors T bezüglich der Basis

die Koordinaten des Tensors T bezüglich der Basis  . Dann ergibt sich für das Transformationsverhalten der Tensorkoordinaten die Gleichung

. Dann ergibt sich für das Transformationsverhalten der Tensorkoordinaten die GleichungEs wird in der Regel zwischen der Koordinatendarstellung des Tensors

und der Transformationsmatrix

und der Transformationsmatrix  unterschieden. Die Transformationsmatrix

unterschieden. Die Transformationsmatrix  ist zwar eine indizierte Größe, aber kein Tensor. Im euklidischen Raum sind das Drehmatrizen und in der speziellen Relativitätstheorie z.B. Lorentz-Transformationen, die sich auch als „Drehungen“ in einem vierdimensionalen Minkowskiraum auffassen lassen. Man spricht in diesem Fall auch von Vierertensoren und Vierervektoren.

ist zwar eine indizierte Größe, aber kein Tensor. Im euklidischen Raum sind das Drehmatrizen und in der speziellen Relativitätstheorie z.B. Lorentz-Transformationen, die sich auch als „Drehungen“ in einem vierdimensionalen Minkowskiraum auffassen lassen. Man spricht in diesem Fall auch von Vierertensoren und Vierervektoren.Operationen auf Tensoren

Neben dem Tensorprodukt gibt es für (r,s)-Tensoren weitere wichtige Operationen.

Inneres Produkt

Das interne Produkt eines Vektors

(bzw. eines (Ko)Vektors

(bzw. eines (Ko)Vektors  ) mit einem Tensor

) mit einem Tensor  ist der (r,s − 1) (bzw. (r − 1,s))-Tensor, welcher durch

ist der (r,s − 1) (bzw. (r − 1,s))-Tensor, welcher durchbzw. durch

definiert ist. Dies bedeutet, dass der (r,s)-Tensor t an einem festen Vektor v bzw. festen Kovektor β ausgewertet wird.

Tensorverjüngung

Gegeben sei ein (r,s)-Tensor und

und

und  . Die Tensorverjüngung

. Die Tensorverjüngung  bildet den Tensor

bildet den Tensorauf den Tensor

ab. Dieser Vorgang heißt Tensorverjüngung oder Spurbildung. Im Fall von (1,1)-Tensoren entspricht die Tensorverjüngung

unter der Identifizierung

der Spur eines Endomorphismus.

der Spur eines Endomorphismus.Mit Hilfe der einsteinschen Summenkonvention kann man die Tensorverjüngung sehr kurz darstellen. Seien beispielsweise

die Koeffizienten (bzw. Koordinaten) des zweistufigen Tensors T bezüglich einer gewählten Basis. Will man diesen (1,1)-Tensor verjüngen, so schreibt man oft anstatt

die Koeffizienten (bzw. Koordinaten) des zweistufigen Tensors T bezüglich einer gewählten Basis. Will man diesen (1,1)-Tensor verjüngen, so schreibt man oft anstatt  nur die Koeffizienten

nur die Koeffizienten  . Die einsteinsche Summenkonvention besagt nun, dass über alle gleichen Indizes summiert wird und somit

. Die einsteinsche Summenkonvention besagt nun, dass über alle gleichen Indizes summiert wird und somit  ein Skalar ist, die mit der Spur des Endomorphismus übereinstimmt. Der Ausdruck Biji ist hingegen nicht definiert, weil nur über gleiche Indizes summiert wird, wenn einer oben und einer unten steht. Hingegen ist also Bijj ein Tensor erster Stufe.

ein Skalar ist, die mit der Spur des Endomorphismus übereinstimmt. Der Ausdruck Biji ist hingegen nicht definiert, weil nur über gleiche Indizes summiert wird, wenn einer oben und einer unten steht. Hingegen ist also Bijj ein Tensor erster Stufe.Pull-Back (Rücktransport)

Sei

eine lineare Abbildung zwischen Vektorräumen, welche kein Isomorphismus zu sein braucht. Der Rücktransport von ϕ sei eine Abbildung

eine lineare Abbildung zwischen Vektorräumen, welche kein Isomorphismus zu sein braucht. Der Rücktransport von ϕ sei eine Abbildung  , welche durch

, welche durchdefiniert ist. Dabei ist

und

und  .

.Push-Forward

Sei

ein Vektorraumisomorphismus. Definiere den Push-Forward von ϕ durch

ein Vektorraumisomorphismus. Definiere den Push-Forward von ϕ durch  mit

mitDabei ist

,

,  und

und  . Mit ϕ * (βi) wird der Rücktransport der Linearform βi notiert. Konkret heißt dies ϕ * (βi(.)) = βi(ϕ(.)). Analog zum Rücktransport kann man beim Push-Forward auf die Isomorphie von ϕ verzichten und diese Operation nur für (r,0)-Tensoren definieren.

. Mit ϕ * (βi) wird der Rücktransport der Linearform βi notiert. Konkret heißt dies ϕ * (βi(.)) = βi(ϕ(.)). Analog zum Rücktransport kann man beim Push-Forward auf die Isomorphie von ϕ verzichten und diese Operation nur für (r,0)-Tensoren definieren.Tensorproduktraum

In diesem Abschnitt werden Tensorprodukträume definiert. Diese werden typischerweise in der Algebra betrachtet. Diese Definition ist allgemeiner als die der (r,s)-Tensoren, da hier die Tensorräume aus unterschiedlichen Vektorräumen konstruiert werden können.

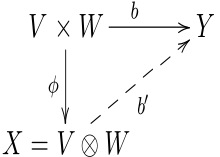

Die universelle Eigenschaft

Es seien V und W Vektorräume über dem Körper K. Sind X,Y weitere K-Vektorräume,

eine beliebige bilineare Abbildung und

eine beliebige bilineare Abbildung und  eine lineare Abbildung, dann ist auch die Verknüpfung

eine lineare Abbildung, dann ist auch die Verknüpfung  eine bilineare Abbildung. Ist also eine bilineare Abbildung gegeben, so kann man daraus auch beliebig viele weitere bilineare Abbildungen konstruieren. Die Frage, die sich ergibt, ist, ob es eine bilineare Abbildung gibt, aus der auf diese Art, durch Verknüpfung mit linearen Abbildungen, alle bilinearen Abbildungen auf

eine bilineare Abbildung. Ist also eine bilineare Abbildung gegeben, so kann man daraus auch beliebig viele weitere bilineare Abbildungen konstruieren. Die Frage, die sich ergibt, ist, ob es eine bilineare Abbildung gibt, aus der auf diese Art, durch Verknüpfung mit linearen Abbildungen, alle bilinearen Abbildungen auf  (auf eindeutige Weise) konstruiert werden können. Ein solches universelles Objekt, d.h. die bilineare Abbildung samt ihrem Bildraum, wird als Tensorprodukt von V und W bezeichnet.

(auf eindeutige Weise) konstruiert werden können. Ein solches universelles Objekt, d.h. die bilineare Abbildung samt ihrem Bildraum, wird als Tensorprodukt von V und W bezeichnet.Definition: Als Tensorprodukt der Vektorräume V und W, wird jeder K-Vektorraum X bezeichnet, zu dem es eine bilineare Abbildung

gibt, die die folgende universelle Eigenschaft erfüllt:

gibt, die die folgende universelle Eigenschaft erfüllt:- Zu jeder bilinearen Abbildung

von

von  in einen Vektorraum Y existiert genau eine lineare Abbildung

in einen Vektorraum Y existiert genau eine lineare Abbildung  , so dass für alle

, so dass für alle  gilt

gilt

- b(v,w) = b'(ϕ(v,w)).

Gibt es einen solchen Vektorraum X, so ist er bis auf Isomorphie eindeutig. Man schreibt

und

und  . Die universelle Eigenschaft kann also als

. Die universelle Eigenschaft kann also als  geschrieben werden. Zur Konstruktion solcher Produkträume sei auf den Artikel Tensorprodukt verwiesen.

geschrieben werden. Zur Konstruktion solcher Produkträume sei auf den Artikel Tensorprodukt verwiesen.Tensor als Element des Tensorproduktes

In der Mathematik sind Tensoren Elemente von Tensorprodukten.

Es sei K ein Körper und es seien

Vektorräume über dem Körper K.

Vektorräume über dem Körper K.Das Tensorprodukt

von

von  ist ein K-Vektorraum, dessen Elemente Summen von Symbolen der Form

ist ein K-Vektorraum, dessen Elemente Summen von Symbolen der Formsind. Dabei gelten für diese Symbole die folgenden Rechenregeln:

Die Tensoren der Form

heißen elementar. Jeder Tensor lässt sich als Summe von elementaren Tensoren schreiben, aber diese Darstellung ist außer in trivialen Fällen nicht eindeutig, wie man an der ersten der beiden Rechenregeln sieht.

heißen elementar. Jeder Tensor lässt sich als Summe von elementaren Tensoren schreiben, aber diese Darstellung ist außer in trivialen Fällen nicht eindeutig, wie man an der ersten der beiden Rechenregeln sieht.Ist

eine Basis von Vi (für

eine Basis von Vi (für  ; di = dim Vi), so ist

; di = dim Vi), so isteine Basis von

Die Dimension von

Die Dimension von  ist also das Produkt der Dimensionen der einzelnen Vektorräume

ist also das Produkt der Dimensionen der einzelnen Vektorräume

Tensorprodukte und Multilinearformen

Der Dualraum von

kann mit dem Raum der s-Multilinearformen

kann mit dem Raum der s-Multilinearformenidentifiziert werden:

- Ist

eine Linearform auf

eine Linearform auf  so ist die entsprechende Multilinearform

so ist die entsprechende Multilinearform

- Ist

eine s-Multilinearform, so ist die entsprechende Linearform auf

eine s-Multilinearform, so ist die entsprechende Linearform auf  definiert durch

definiert durch

Sind alle betrachteten Vektorräume endlichdimensional, so kann man

miteinander identifizieren, d.h. Elemente von

entsprechen s-Multilinearformen auf

entsprechen s-Multilinearformen auf

Tensorprodukte eines Vektorraums und Symmetrie

Man kann das Tensorprodukt

eines Vektorraumes V mit sich selbst bilden. Ohne weiteres Wissen über den Vektorraum kann ein Automorphismus des Tensorprodukts definiert werden, der darin besteht, in den reinen Produkten

eines Vektorraumes V mit sich selbst bilden. Ohne weiteres Wissen über den Vektorraum kann ein Automorphismus des Tensorprodukts definiert werden, der darin besteht, in den reinen Produkten  die Faktoren zu vertauschen,

die Faktoren zu vertauschen, .

.

Das Quadrat dieser Abbildung ist die Identität, woraus folgt, dass es Eigenvektoren zum Eigenwert 1 und zum Eigenwert -1 gibt.

- Ein

, welches Π12(w): = w erfüllt, heißt symmetrisch. Beispiele sind die Elemente

, welches Π12(w): = w erfüllt, heißt symmetrisch. Beispiele sind die Elemente

-

.

.- Die Menge aller symmetrischen Tensoren der Stufe 2 wird mit

bezeichnet.

bezeichnet.

- Ein

, welches Π12(w): = − w erfüllt, heißt antisymmetrisch oder alternierend. Beispiele sind die Elemente

, welches Π12(w): = − w erfüllt, heißt antisymmetrisch oder alternierend. Beispiele sind die Elemente

-

.

.- Die Menge aller antisymmetrischen Tensoren der Stufe 2 wird mit

bezeichnet.

bezeichnet.

Mittels

können Tensorpotenzen von V beliebiger Stufe gebildet werden. Entsprechend können weitere paarweise Vertauschungen definiert werden. Nur sind diese nicht mehr voneinander unabhängig. So lässt sich jede Vertauschung der Stellen j und k auf Vertauschungen mit der ersten Stelle zurückführen.

können Tensorpotenzen von V beliebiger Stufe gebildet werden. Entsprechend können weitere paarweise Vertauschungen definiert werden. Nur sind diese nicht mehr voneinander unabhängig. So lässt sich jede Vertauschung der Stellen j und k auf Vertauschungen mit der ersten Stelle zurückführen.Injektives und projektives Tensorprodukt

Falls die Vektorräume, welche man miteinander tensorieren will, eine Topologie besitzen so ist es wünschenswert, dass ihr Tensorprodukt ebenfalls eine Topologie besitzt. Es gibt natürlich viele Möglichkeiten eine solche Topologie zu definieren. Das injektive beziehungsweise das projektive Tensorprodukt sind dafür jedoch eine natürliche Wahl.

Tensoranalysis

Ursprünglich wurde das Tensorkalkül nicht in dem modernen hier vorgestellten algebraischen Konzept untersucht. Das Tensorkalkül entstand aus Überlegungen zur Differentialgeometrie. Insbesondere Gregorio Ricci-Curbastro und seine Schüler Tullio Levi-Civita haben es entwickelt. Man nennt das Tensorkalkül daher auch Ricci-Kalkül. Albert Einstein griff dieses Kalkül in seiner Relativitätstheorie auf, was ihm große Bekanntheit in der Fachwelt einbrachte. Die damaligen Tensoren werden heute als Tensorfelder bezeichnet und spielen in der Differentialgeometrie auch heute noch eine wichtige Rolle. Im Gegensatz zu Tensoren sind Tensorfelder differenzierbare Abbildungen, die jedem Punkt des zugrundeliegenden (oftmals gekrümmten) Raums einen Tensor zuordnen.

Literatur

- Theodor Bröcker: Lineare Algebra und Analytische Geometrie. Birkhäuser, Basel 2004, ISBN 3-7643-2178-4, Kap. VII: Tensorrechnung.

- R. Abraham, J. E. Marsden, T. Ratiu: Manifolds, tensor analysis, and applications. 2. Auflage. Springer, New York NY u. a. 1998, ISBN 0-387-96790-7, (Applied mathematical sciences 75).

- Theodore Frankel: The Geometry of Physics. An Introduction. Cambridge University Press, Cambridge u. a. 1997, ISBN 0-521-38334-X

- Horst Teichmann: Physikalische Anwendungen der Vektor- und Tensorrechnung. 3. Auflage. Bibliographisches Institut, Mannheim u. a. 1973, ISBN 3-411-00039-2, (BI-Hochschultaschenbücher 39).

- André Lichnerowicz: Einführung in die Tensoranalysis. Bibliographisches Institut, Mannheim u. a. 1966, (BI Hochschultaschenbuch 77).

Weblinks

- Mike Georg Bernhardt: Über Tensoren, Matrizen und Pseudovektoren (PDF, deutsch, 132 kB)

- Joseph C. Kolecki: An Introduction to Tensors for Students of Physics and Engineering (Einführung in die Tensorrechnung für Studenten, PDF, englisch, 328 kB, NASA-Publikation)

- Eigenvalue-Eigenvector Glyphs: Visualizing Zeroth, Second, Fourth and Higher Order Tensors in a Continuum (Webseite zur Visualisierung von Vektoren, englisch)

Wikimedia Foundation.