- Binomial-Verteilung

-

Dieser Artikel wurde auf der Qualitätssicherungsseite des Portals Mathematik eingetragen. Dies geschieht, um die Qualität der Artikel aus dem Themengebiet Mathematik auf ein akzeptables Niveau zu bringen. Dabei werden Artikel gelöscht, die nicht signifikant verbessert werden können. Bitte hilf mit, die Mängel dieses Artikels zu beseitigen, und beteilige dich bitte an der Diskussion!

Die Binomialverteilung (manchmal nicht ganz korrekt auch Bernoulli-Verteilung genannt) ist eine der wichtigsten diskreten Wahrscheinlichkeitsverteilungen.

Sie beschreibt den wahrscheinlichen Ausgang einer Folge von gleichartigen Versuchen, die jeweils nur zwei mögliche Ergebnisse haben, also die Ergebnisse von Bernoulli-Prozessen. Wenn das gewünschte Ergebnis eines Versuches die Wahrscheinlichkeit p besitzt, und die Zahl der Versuche n ist, dann gibt die Binomialverteilung an, mit welcher Wahrscheinlichkeit sich insgesamt k Erfolge einstellen. Unter diesen Voraussetzungen ist der Versuch ein Bernoulli-Versuch.

Die Binomialverteilung ist zur Beschreibung von Zufallsgrößen der folgenden Art geeignet:

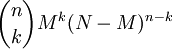

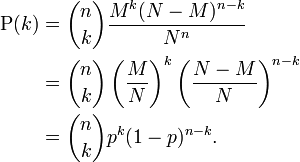

- Die Bestimmung der Anzahl einer bestimmten Eigenschaft in einer Stichprobe aus einer Menge von Elementen, wenn die Reihenfolge beim Entnehmen der Stichprobe aus der Gesamtmenge keine Rolle spielt, und die entnommenen Elemente wieder zurückgelegt werden („Ziehen mit Zurücklegen“). Beispiel: Ein Korb enthält N Bälle, davon sind M schwarz und N − M weiß. Die Wahrscheinlichkeit, einen schwarzen Ball zu ziehen, ist also p = M / N. Es werden einzeln und nacheinander insgesamt n Bälle entnommen, untersucht und wieder zurückgelegt. Dabei werden k Schwarze identifiziert. Insgesamt gibt es Nn Möglichkeiten für die Auswahl der Bälle. In

Fällen davon werden k schwarze Bälle ausgewählt, d. h. die Wahrscheinlichkeit, unter n Bällen genau k schwarze zu finden ist

Fällen davon werden k schwarze Bälle ausgewählt, d. h. die Wahrscheinlichkeit, unter n Bällen genau k schwarze zu finden ist

- Der erste Term ist der Binomialkoeffizient. Die Binomialverteilung ist dabei auch auf Probleme ohne Zurücklegen anwendbar. Diese Bedingung existiert in diesem Beispiel, damit die Wahrscheinlichkeit für den Erfolg sich nicht ändert.

Die Binomialverteilung bzw. der Bernoulliversuch kann mit Hilfe des Galtonbretts veranschaulicht werden. Dabei handelt es sich um eine mechanische Apparatur, in die man eine beliebige Zahl von Kugeln werfen kann. Diese fallen dann zufällig in eines von mehreren Fächern, wobei die Aufteilung der Binomialverteilung entspricht.

Obwohl die Binomialverteilung bereits lange vorher bekannt war, wurde der Begriff zum ersten Mal 1911 in einem Buch von George Udny Yule verwendet.[1]

Inhaltsverzeichnis

Definition der Binomialverteilung

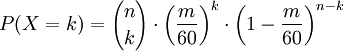

Die diskrete Wahrscheinlichkeitsverteilung

heißt die Binomialverteilung zu den Parametern n (Anzahl der Versuche) und

![p\in [0,1]](/pictures/dewiki/53/550abf67410399d394e58560a62f657a.png) (Trefferwahrscheinlichkeit).

(Trefferwahrscheinlichkeit).Dabei wird nur den Zahlen

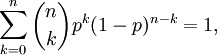

eine Wahrscheinlichkeit ungleich Null zugeordnet. Die zur Trefferwahrscheinlichkeit p komplementäre Ausfallwahrscheinlichkeit 1 − p wird häufig als q abgekürzt. Nach dem binomischen Lehrsatz gilt

eine Wahrscheinlichkeit ungleich Null zugeordnet. Die zur Trefferwahrscheinlichkeit p komplementäre Ausfallwahrscheinlichkeit 1 − p wird häufig als q abgekürzt. Nach dem binomischen Lehrsatz giltwas eine notwendige Bedingung für eine Wahrscheinlichkeitsverteilung darstellt.

Eine diskrete Zufallsgröße X heißt binomialverteilt mit den Parametern n und p, wenn sie die Wahrscheinlichkeiten

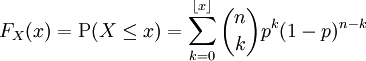

und damit die Verteilungsfunktion

besitzt.

Eigenschaften der Binomialverteilung

Symmetrie

- Die Binomialverteilung ist im Spezialfall p = 0,5 symmetrisch und ansonsten asymmetrisch.

- Die Binomialverteilung besitzt die Eigenschaft B(k | p,n) = B(n − k | q,n) mit q = 1 − p.

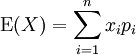

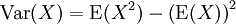

Erwartungswert und Varianz

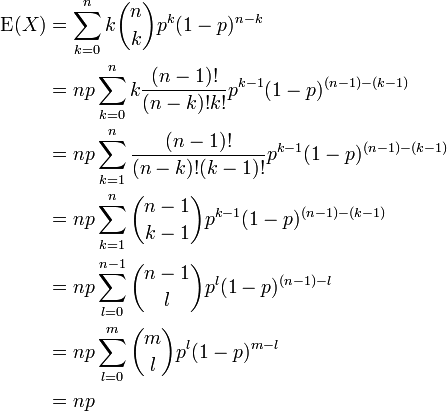

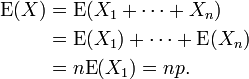

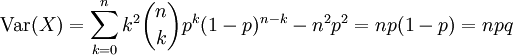

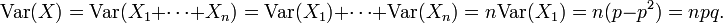

Die Binomialverteilung besitzt den Erwartungswert np und die Varianz npq mit q = 1 − p.

Beweis

Den Erwartungswert errechnet man direkt aus der Definition

zu

zuoder alternativ mit der Summenregel für Erwartungswerte, wenn man berücksichtigt, dass die identischen Einzelprozesse der Bernoulli-Verteilung mit

genügen, zu

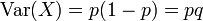

genügen, zuDie Varianz bestimmt sich analog direkt aus dem Verschiebungssatz

zu

zuoder alternativ aus der Summenregel für die Varianz unabhängiger Zufallsvariablen, wenn man berücksichtigt, dass die identischen Einzelprozesse der Bernoulli-Verteilung mit

genügen, zu

genügen, zuDie zweite Gleichheit gilt, da die Einzelexperimente unabhängig sind, so dass die Einzelvariablen unkorreliert sind.

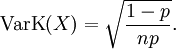

Variationskoeffizient

Aus Erwartungswert und Varianz erhält man sofort den Variationskoeffizienten

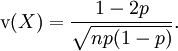

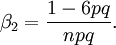

Schiefe und Wölbung

Die Schiefe ergibt sich zu

Die Wölbung lässt sich ebenfalls geschlossen darstellen als

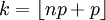

Maximum

Das Maximum wird für p < 1 bei

und für p = 1 bei n angenommen. Falls np + p eine natürliche Zahl ist, ist B(k | p,n) auch bei k = np + p − 1 maximal. Falls der Erwartungswert eine natürliche Zahl ist, ist der Erwartungswert die Maximalstelle.

und für p = 1 bei n angenommen. Falls np + p eine natürliche Zahl ist, ist B(k | p,n) auch bei k = np + p − 1 maximal. Falls der Erwartungswert eine natürliche Zahl ist, ist der Erwartungswert die Maximalstelle.Beweis

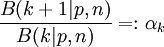

Sei ohne Einschränkung 0 < p < 1. Wir schauen uns den Quotienten

an. Es gilt

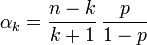

an. Es gilt  . Nun gilt αk > 1 falls k < np − (1 − p) und αk < 1 falls k > np − (1 − p). Und nur im Falle, dass

. Nun gilt αk > 1 falls k < np − (1 − p) und αk < 1 falls k > np − (1 − p). Und nur im Falle, dass  , ist B(np − (1 − p) | n,p) = B(np + p | n,p). Die Aussage ist bewiesen.

, ist B(np − (1 − p) | n,p) = B(np + p | n,p). Die Aussage ist bewiesen.Charakteristische Funktion

Die charakteristische Funktion hat die Form

- φX(s) = ((1 − p) + peis)n = (q + peis)n.

Erzeugende Funktion

Für die erzeugende Funktion erhält man

- gX(s) = (ps + (1 − p))n.

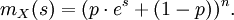

Momenterzeugende Funktion

Die momenterzeugende Funktion der Binomialverteilung lautet

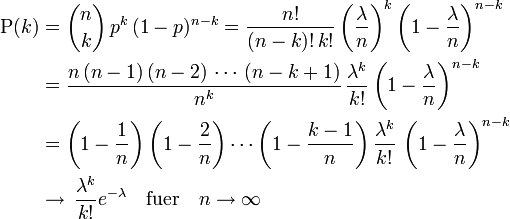

Summe binomialverteilter Zufallsgrößen

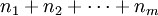

Für die Summe Z = X + Y zweier unabhängiger binomialverteilter Zufallsgrößen X und Y mit den Parametern n1, p und n2, p erhält man die Einzelwahrscheinlichkeiten

also wieder eine binomialverteilte Zufallsgröße, jedoch mit den Parametern n1 + n2 und p.

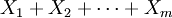

Allgemein gilt: Wenn die m Zufallsvariablen Xi stochastisch unabhängig sind und den Binomialverteilungen B(ni,p) genügen, dann ist auch die Summe

binomialverteilt, jedoch mit den Parametern

binomialverteilt, jedoch mit den Parametern  und p.

und p.So ist zum Beispiel

hypergeometrisch verteilt.

Beziehung zu anderen Verteilungen

Beziehung zur Bernoulli-Verteilung

Ein Spezialfall der Binomialverteilung für n = 1 ist die Bernoulli-Verteilung. Die Summe von unabhängigen und identischen Bernoulli-verteilten Zufallsgrößen genügt demnach der Binomialverteilung.

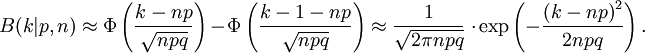

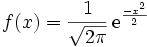

Übergang zur Normalverteilung

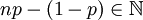

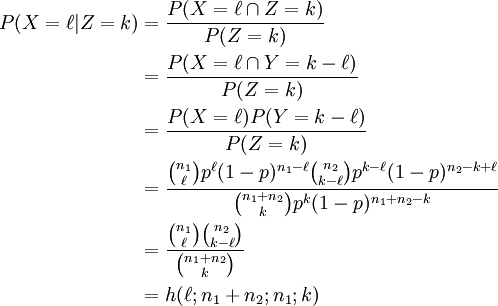

Im Grenzfall

konvergiert die Binomialverteilung gegen eine Normalverteilung, d. h. die Normalverteilung kann als brauchbare Näherung der Binomialverteilung verwendet werden, wenn der Stichprobenumfang hinreichend groß und der Anteil der gesuchten Ausprägung nicht zu klein sind. (vgl. den Satz von Moivre-Laplace)

konvergiert die Binomialverteilung gegen eine Normalverteilung, d. h. die Normalverteilung kann als brauchbare Näherung der Binomialverteilung verwendet werden, wenn der Stichprobenumfang hinreichend groß und der Anteil der gesuchten Ausprägung nicht zu klein sind. (vgl. den Satz von Moivre-Laplace)Es gilt: μ = np und σ2 = npq. Durch Einsetzung in die Verteilungsfunktion der Normalverteilung folgt:

Eine Faustregel besagt, dass diese Näherung brauchbar ist, sofern np > 4 und nq > 4, oder auch

. Je asymmetrischer die Binomialverteilung, umso größer muss n sein, bevor die Normalverteilung eine brauchbare Näherung liefert.

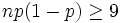

. Je asymmetrischer die Binomialverteilung, umso größer muss n sein, bevor die Normalverteilung eine brauchbare Näherung liefert.Übergang zur Poisson-Verteilung

Eine asymptotisch asymmetrische Binomialverteilung, deren Erwartungswert np für große

und kleine

und kleine  gegen eine von n unabhängige Konstante λ konvergiert, kann man durch die Poisson-Verteilung annähern. Der Wert λ ist dann für alle in der Grenzwertbildung betrachteten Binomialverteilungen wie auch für die resultierende Poissonverteilung der Erwartungswert. Diese Annäherung wird auch als Poissonscher Grenzwertsatz oder als das Gesetz seltener Ereignisse bezeichnet.

gegen eine von n unabhängige Konstante λ konvergiert, kann man durch die Poisson-Verteilung annähern. Der Wert λ ist dann für alle in der Grenzwertbildung betrachteten Binomialverteilungen wie auch für die resultierende Poissonverteilung der Erwartungswert. Diese Annäherung wird auch als Poissonscher Grenzwertsatz oder als das Gesetz seltener Ereignisse bezeichnet.

Eine Faustregel besagt, dass diese Näherung brauchbar ist, sofern

und n > 1500p, gleichbedeutend mit

und n > 1500p, gleichbedeutend mit  und

und  .

.Die Poisson-Verteilung ist also die Grenzverteilung der Binomialverteilung für große n und kleine p.

Beziehung zur negativen Binomialverteilung

Die negative Binomialverteilung hingegen beschreibt die Wahrscheinlichkeitsverteilung der Anzahl der Versuche, die erforderlich sind, um in einem Bernoulli-Prozess eine vorgegebene Anzahl von Erfolgen zu erzielen. Die Zahl der Misserfolge bis zum erstmaligen Eintritt eines Erfolgs wird durch die geometrische Verteilung beschrieben.

Beziehung zur Hypergeometrischen Verteilung

Bei der Binomialverteilung werden die ausgewählten Stichproben wieder zur Auswahlmenge zurückgeführt, können also zu einem späteren Zeitpunkt erneut ausgewählt werden. Werden im Gegensatz dazu die Stichproben nicht zur Grundgesamtheit zurückgegeben, dann kommt die Hypergeometrische Verteilung zur Anwendung. Beide gehen bei großem Umfang N der Grundgesamtheit und geringem Umfang n der Stichproben ineinander über. Als Daumenwert gilt, dass für

die Binomialverteilung der mathematisch anspruchsvolleren Hypergeometrischen Verteilung vorgezogen werden kann, da sie nur unwesentlich voneinander abweichende Ergebnisse liefern.

die Binomialverteilung der mathematisch anspruchsvolleren Hypergeometrischen Verteilung vorgezogen werden kann, da sie nur unwesentlich voneinander abweichende Ergebnisse liefern.Beziehung zur Multinomial-Verteilung

Die Binomialverteilung ist ein Spezialfall sowohl der Multinomialverteilung als auch der Panjer-Verteilung.

Beispiele

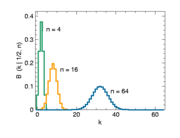

Symmetrische Binomialverteilung (p gleich 1/2)

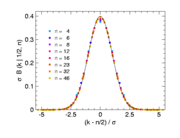

Dieses Bild zeigt die Binomialverteilung für p = 0,5 und verschiedene Werte von n als Funktion von k:

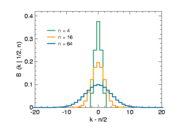

Diese Funktion ist spiegelsymmetrisch um den Wert k = n / 2:

- B(k | 0,5,n) = B(n − k | 0,5,n),

wie die folgende Auftragung zeigt:

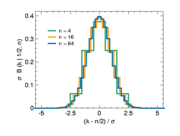

Die Breite der Verteilung wächst proportional zur Standardabweichung

. Der Funktionswert bei k = n / 2, also das Maximum der Kurve, sinkt proportional zu σ. Dementsprechend kann man Binomialverteilungen mit unterschiedlichem n aufeinander skalieren, indem man die Abszisse k − n / 2 durch σ teilt und die Ordinate mit σ multipliziert:

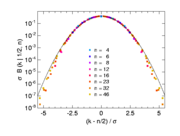

. Der Funktionswert bei k = n / 2, also das Maximum der Kurve, sinkt proportional zu σ. Dementsprechend kann man Binomialverteilungen mit unterschiedlichem n aufeinander skalieren, indem man die Abszisse k − n / 2 durch σ teilt und die Ordinate mit σ multipliziert:Das folgende Bild zeigt noch einmal reskalierte Binomialverteilungen, nun für andere Werte von n und in einer Auftragung, die besser verdeutlicht, dass sämtliche Funktionswerte mit steigendem n gegen eine gemeinsame Kurve konvergieren. Indem man die Stirling-Formel auf die Binomialkoeffizienten anwendet, erkennt man, dass diese Kurve (im Bild schwarz durchgezogen) eine Gaußsche Glockenkurve ist:

.

.

Dies ist die Wahrscheinlichkeitsdichte zur Standard-Normalverteilung

. Im zentralen Grenzwertsatz wird dieser Befund so verallgemeinert, dass auch Folgen anderer diskreter Wahrscheinlichkeitsverteilungen gegen die Normalverteilung konvergieren.

. Im zentralen Grenzwertsatz wird dieser Befund so verallgemeinert, dass auch Folgen anderer diskreter Wahrscheinlichkeitsverteilungen gegen die Normalverteilung konvergieren.Und hier die gleichen Daten in einer halblogarithmischen Auftragung, die sehr zu empfehlen ist, wenn man überprüfen möchte, ob auch seltene Ereignisse, die um mehrere Standardabweichungen vom Erwartungswert abweichen, einer Binomial- oder Normalverteilung folgen:

Ziehen von Kugeln

In einem Behälter befinden sich 80 Kugeln, davon sind 16 gelb. Es wird 5-mal eine Kugel entnommen und anschließend wieder zurückgelegt. Wegen des Zurücklegens ist die Wahrscheinlichkeit, eine gelbe Kugel zu ziehen, bei allen Entnahmen gleich groß: 16/80 = 1/5 = 0,2. Die Verteilung B(k|0,2; 5) gibt die Wahrscheinlichkeit dafür an, dass genau k der entnommenen Kugeln gelb sind.

B(k|0,2; 5) k Wahrscheinlichkeit in % 0 32,768 1 40,96 2 20,48 3 5,12 4 0,64 5 0,032 ∑ 100 Erw.Wert 1 Varianz 0.8 Anzahl Personen mit Geburtstag am Wochenende

Die Wahrscheinlichkeit, dass eine Person in diesem Jahr an einem Wochenende Geburtstag hat, beträgt 2/7. In einem Raum halten sich 10 Personen auf. Die Verteilung B(k|2/7; 10) gibt die Wahrscheinlichkeit dafür an, dass genau k der Anwesenden in diesem Jahr an einem Wochenende Geburtstag haben.

B(k|2/7; 10) k Wahrscheinlichkeit in % (gerundet) 0 3,46 1 13,83 2 24,89 3 26,55 4 18,59 5 8,92 6 2,97 7 0,68 8 0,10 9 0,01 10 0,00036 ∑ 100 Erw.Wert 2,86 Varianz 2,04 Gemeinsamer Geburtstag im Jahr

253 Personen sind zusammen gekommen. Die Verteilung B(k|1/365; 253) gibt die Wahrscheinlichkeit an, dass genau k Anwesende an einem zufällig gewählten Tag Geburtstag haben.

B(k|1/365; 253) k Wahrscheinlichkeit in % (gerundet) 0 49,95 1 34,72 2 12,02 3 2,76 4 0,47 Die Wahrscheinlichkeit, dass "irgendjemand" dieser 253 Personen, d.h. 1 oder mehrere Personen, an diesem Tag Geburtstag haben, beträgt somit 1 - B(0|1/365; 253) = 50.05%. Die Schwelle der Anzahl von Personen, ab der die Wahrscheinlichkeit, dass mindestens 1 dieser Personen an einem zufällig gewählten Tag Geburtstag hat, größer als 50% wird, beträgt 253 Personen (siehe Geburtstagsparadoxon).

Die direkte Berechnung der Binomialverteilung kann aufgrund der großen Fakultäten schwierig sein. Eine Näherung über die Poisson-Verteilung ist zulässig (n>50, p<0,05). Mit dem Parameter λ = np = 253/365 ergeben sich folgende Werte:

P253/365(k) k Wahrscheinlichkeit in % (gerundet) 0 50 1 34,66 2 12,01 3 2,78 4 0,48 Konfidenzintervall für eine Wahrscheinlichkeit

In einer Meinungsumfrage unter n Personen geben k Personen an, die Partei A zu wählen. Bestimme ein 95% -Konfindenzintervall.

Eine Lösung des Problems ohne Rückgriff auf die Normalverteilung findet sich im Artikel Konfidenzintervall einer unbekannten Wahrscheinlichkeit.

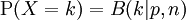

Auslastungsmodell

Mittels folgender Formel lässt sich die Wahrscheinlichkeit dafür errechnen, dass k von n Personen eine Tätigkeit, die durchschnittlich m Minuten pro Stunde dauert, gleichzeitig ausführen.

Zufallszahlen

Zufallszahlen zur Binomialverteilung werden üblicherweise mit Hilfe der Inversionsmethode erzeugt.

Einzelnachweise

- ↑ George Udny Yule: An Introduction to the Theory of Statistics. Griffin, London 1911, S. 287

Weblinks

- Bernoulli-Versuche und Binomialverteilung

- Tabellen zur Binomialverteilung für einfache und kumulierte Wahrscheinlichkeiten

- Binomial- und Normalverteilung – Online-Lehrgang mit dynamischen Arbeitsblättern (Java-Plugin benötigt)

- Interaktive Animation – Universität Konstanz (Java-Plugin benötigt)

- Interaktive Animation (Flash-Plugin benötigt)

- Earliest Known Uses of Some of the Words of Probability & Statistics - Kees Verduin.

Diskrete univariate VerteilungenDiskrete univariate Verteilungen für endliche Mengen:

Benford | Bernoulli-Verteilung | Binomialverteilung | Kategoriale | Hypergeometrische Verteilung | Rademacher | Zipfsche | Zipf-MandelbrotDiskrete univariate Verteilungen für unendliche Mengen:

Boltzmann | Conway-Maxwell-Poisson | Negative Binomialverteilung | Erweiterte negative Binomial | Compound Poisson | Diskret uniform | Discrete phase-type | Gauss-Kuzmin | Geometrische | Logarithmische | Parabolisch-fraktale | Poisson | Skellam | Yule-Simon | ZetaKontinuierliche univariate VerteilungenKontinuierliche univariate Verteilungen mit kompaktem Intervall:

Beta | Kumaraswamy | Raised Cosine | Dreiecks | U-quadratisch | Stetige Gleichverteilung | Wigner-HalbkreisKontinuierliche univariate Verteilungen mit halboffenem Intervall:

Beta prime | Bose-Einstein | Burr | Chi-Quadrat | Coxian | Erlang | Exponential | F | Fermi-Dirac | Folded Normal | Fréchet | Gamma | Extremwert | Verallgemeinerte inverse Gausssche | Halblogistische | Halbnormale | Hotellings T-Quadrat | hyper-exponentiale | hypoexponential | Inverse Chi-Quadrat | Scale Inverse Chi-Quadrat | Inverse Normal | Inverse Gamma | Lévy | Log-normal | Log-logistische | Maxwell-Boltzmann | Maxwell speed | Nakagami | nichtzentrierte Chi-Quadrat | Pareto | Phase-type | Rayleigh | relativistische Breit-Wigner | Rice | Rosin-Rammler | Shifted Gompertz | Truncated Normal | Type-2-Gumbel | Weibull | Wilks’ lambdaKontinuierliche univariate Verteilungen mit unbeschränktem Intervall:

Cauchy | Extremwert | Exponential Power | Fisher’s z | Fisher-Tippett (Gumbel) | Generalized Hyperbolic | Hyperbolic Secant | Landau | Laplace | Alpha stabile | logistisch | Normal (Gauss) | Normal-inverse Gausssche | Skew normal | Studentsche t | Type-1 Gumbel | Variance-Gamma | VoigtMultivariate VerteilungenDiskrete multivariate Verteilungen:

Ewen's | Multinomial | Dirichlet MultinomialKontinuierliche multivariate Verteilungen:

Dirichlet | Generalized Dirichlet | Multivariate Normal | Multivariate Student | Normalskalierte inverse Gamma | Normal-GammaMultivariate Matrixverteilungen:

Inverse-Wishart | Matrix Normal | Wishart - Die Bestimmung der Anzahl einer bestimmten Eigenschaft in einer Stichprobe aus einer Menge von Elementen, wenn die Reihenfolge beim Entnehmen der Stichprobe aus der Gesamtmenge keine Rolle spielt, und die entnommenen Elemente wieder zurückgelegt werden („Ziehen mit Zurücklegen“). Beispiel: Ein Korb enthält N Bälle, davon sind M schwarz und N − M weiß. Die Wahrscheinlichkeit, einen schwarzen Ball zu ziehen, ist also p = M / N. Es werden einzeln und nacheinander insgesamt n Bälle entnommen, untersucht und wieder zurückgelegt. Dabei werden k Schwarze identifiziert. Insgesamt gibt es Nn Möglichkeiten für die Auswahl der Bälle. In

Wikimedia Foundation.

![B(\cdot|p,n):\mathbb Z\to [0,1],\,k\mapsto B(k|p,n) = \binom nk p^k (1-p)^{n-k}](/pictures/dewiki/53/51225aba9d8ac654c1fdd7a7bcd3aecb.png)

![\begin{align}

\operatorname P(Z=k) &amp;amp;= \sum_{i=0}^k\left[\binom{n_1}i p^i (1-p)^{n_1-i}\right]\left[\binom{n_2}{k-i} p^{k-i} (1-p)^{n_2-k+i}\right]\\

&amp;amp;= \binom{n_1+n_2}k p^k (1-p)^{n_1+n_2-k} \qquad k=0,1,\ldots,n_1+n_2

\end{align}](/pictures/dewiki/102/f1218e89ba7fc92d374b7d707cb9b7e0.png)